いま問題になっているのは、AIが答えられるかではなく「なぜそれを信じるのか」だ

生成AIの進化で、文章を作ること自体はかなり当たり前になった。

要約もできる。説明もできる。比較も提案もできる。

だが企業でも一般ユーザーでも、最後にいつも残るのは同じ疑問である。

その答えは、なぜ信じていいのかという問いだ。

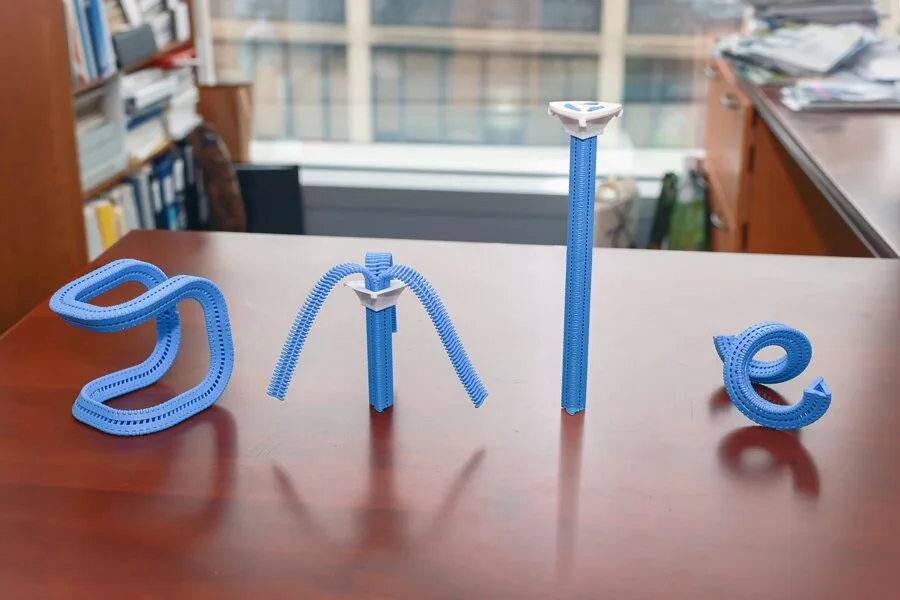

この点で、Googleが出願している特許はかなり示唆的だ。

Googleの公開特許 JP2024163030A は「検索のための人工知能生成バッジ」に関するもので、ウェブ情報を機械学習モデルで処理し、ある製品や対象が「どんな用途に向くか」「どんな利点・欠点があるか」といった情報をバッジとして生成し、それを検索結果の注釈や順位付けに使う仕組みを説明している。特許の要約では、AIがウェブ情報から「特定の品質」を決定し、その品質をもとにバッジを生成し、検索結果の表示やランク付けに利用できるとされている。

ここで重要なのは、Googleが目指しているのが「もっと長い答えを返すこと」ではなく、

検索結果やAI生成結果に、判断の手がかりを付けることだという点である。

つまりAIの信頼性を、モデル内部の精度だけで上げるのではなく、ユーザーが外から理解しやすい形で補強しようとしている。

バッジやメタデータは、AIの“答え”に文脈を戻すための道具だ

この特許で面白いのは、AIがウェブ上のレビュー、製品説明、FAQなどを処理し、

「こういう用途向き」「こういうタイプのユーザーに合う」といった情報を抽出して、

検索結果に重ねる構想になっていることだ。特許本文では、ウェブデータに基づき「特定の使用」や「利点・欠点」を決定し、それをバッジ化して検索結果インターフェースに表示したり、検索結果の選定に使ったりすることが説明されている。

これは見方を変えると、

AIが生成した要約や推薦文に、由来や意味づけのラベルを戻す試みでもある。

生成AIの弱点は、答えが滑らかすぎて、どこまでが事実の集約で、どこからがモデル側の解釈なのかが見えにくいことだ。

バッジやメタデータは、その曖昧さを少し減らす。

ユーザーは単に「おすすめです」と言われるのではなく、

「どんな用途で」「どういう評価軸で」そう言われているかをつかみやすくなる。

要するに、AIの信頼性向上とは、

答えの正確さだけではなく、

答えの輪郭を見せることでもあるのだ。

Googleが進めているのは、検索結果の中に“信頼の手がかり”を埋め込むことだ

この方向性は、特許だけに突然現れたものではない。

Googleはすでに、AI生成コンテンツや画像の来歴を示すために、C2PAの「Content Credentials」対応を進めてきた。Google公式ブログでは、GoogleがC2PAの最新版策定に関わり、コンテンツのprovenance information(来歴情報)を付与・検証する技術を進めていると説明している。Google Searchの「About this image」機能でも、画像がカメラで撮影されたのか、編集されたのか、AI生成なのかを示す方向が打ち出されている。

この流れと今回の特許を重ねると、Googleが一貫して考えていることが見えてくる。

それは、AIや検索の結果そのものを完全に“真偽判定”するのではなく、

ユーザーが信頼判断をしやすい情報を横に添えるという発想だ。

画像なら「来歴メタデータ」。

検索結果なら「AI生成バッジ」。

どちらも共通しているのは、

AIの出力をそのまま信じさせるのではなく、

判断材料をユーザーに返すところにある。

これは“AIの正しさ”を保証する技術ではない

ただし、ここは冷静に見ておく必要がある。

メタデータやバッジが付いたからといって、それだけでAI生成結果が真実になるわけではない。

特許も、対象の「品質」「用途」「利点・欠点」をウェブ情報から推定し、バッジ化する仕組みを示しているのであって、世界の事実を絶対保証する仕組みではない。

つまり、これは正確性の証明書ではなく、

理解しやすさと判断しやすさを高める仕組みなのである。

ここを取り違えると危ない。

AIに「信頼できる」というラベルが付いた瞬間、人は逆に考えることをやめやすい。

だから本当に大事なのは、メタデータを「安心の印」として使うことではなく、

「この結果はどういう根拠や属性を持つのか」を考える入口として使うことだろう。

Googleの動きも、少なくとも公開情報ベースでは、その方向に近い。

来歴情報を見せる。

用途ラベルを見せる。

生成された結果に注釈を付ける。

つまりユーザーの判断を奪うのではなく、

判断の補助線を増やす方向である。

この技術が効くのは、ECや検索だけではない

今回の特許は製品検索やレビュー分析の文脈が強い。

だが考え方そのものは、もっと広い分野で使える。

例えば企業向けAI検索なら、

「社内規程ベース」

「FAQ由来」

「最近更新された情報」

といったメタデータが付くだけで、回答の受け取り方はかなり変わる。

ニュース要約でも、

「一次資料あり」

「複数報道ソース一致」

「推定を含む」

といった表示があれば、ユーザーはだいぶ構えやすい。

つまり、信頼性向上の本質は、AIを万能化することではない。

出力の属性を見える化することにある。

Googleの特許は、その考え方を検索体験の中に入れようとしているように見える。

本当に変わるのは、AIの精度より「受け手の態度」かもしれない

生成AIの議論では、どうしてもモデル性能ばかりが注目される。

だが、現実の利用体験を左右するのは、

実は「ユーザーがその結果をどう読むか」でもある。

バッジやメタデータが機能するのは、

AIが賢くなったからではなく、

ユーザーが結果を読み解くための余白が増えるからだ。

どの用途向きか。

どういう評価が多いのか。

AI生成なのか、カメラ撮影なのか。

そうした補助情報があるだけで、出力は単なる“もっともらしい文章”から、少しだけ“扱いやすい情報”へ近づく。

この意味で、Googleの今回の特許が示しているのは、

AIの未来が「何でも即答するシステム」ではなく、

出力に文脈を添えて返すシステムへ向かっていることなのかもしれない。

今回の特許が示しているもの

【特許】Google、メタデータでAI生成結果の信頼性向上。

この見出しのポイントは、AIの知能そのものより、

信頼の手がかりをどう設計するかにある。

Googleの公開特許では、AIがウェブ情報を処理してバッジを生成し、検索結果の表示や順位付けに活用する構想が示されている。

Googleは別の文脈でも、C2PAの来歴情報を使って、AI生成画像や編集履歴をユーザーに見せる方向を進めている。

両者に共通するのは、

「AIを信じろ」と迫るのではなく、

信じるかどうかを判断する材料を増やすという設計思想だ。

AIの信頼性は、モデルの内部だけでは完成しない。

その答えが、どんな属性を持ち、どんな文脈から来ているのか。

そこまで見えるようになって初めて、ユーザーは本当に使いこなせる。

今回のGoogleの特許は、その当たり前でいて難しい課題に、かなりまっすぐ向き合ったものとして読むべきだろう。